Open, cerrado o híbrido: la pregunta ya no es qué modelo, sino qué cartera

Cada vez más empresas combinan modelos cerrados de frontera con modelos abiertos auto-alojados. Cuándo conviene cada uno, dónde está el punto de equilibrio y por qué el debate ya no es binario.

Hace doce meses la pregunta era cuál era el mejor modelo. Hoy es otra muy distinta: ¿qué mezcla de modelos conviene tener en mi empresa? Después de un año observando despliegues reales, la respuesta breve es que cada vez menos compañías serias se casan con un solo proveedor.

Las dos rutas

La vía rápida está clara: contratas API a un proveedor de frontera y empiezas a iterar el lunes. OpenAI con GPT (el más extendido en producto), Microsoft Copilot (de plug-and-play si ya vives en Microsoft 365), Anthropic con Claude (la familia que más está creciendo en uso empresarial durante 2026), Google con Gemini, etc. Te entregan un modelo cerrado, comercial, top de mercado, a un precio bajo por token, y todo lo demás es problema de ellos. A cambio renuncias a tocar nada por dentro y aceptas que tus datos pasan por su infraestructura.

La vía menos obvia es la que están explorando los equipos técnicamente más maduros, normalmente después de hacerse una pregunta incómoda: ¿de verdad necesito un Ferrari para llevar la compra del supermercado? Aquí entran los modelos de pesos abiertos: Llama (Meta), Mistral, Qwen (Alibaba), DeepSeek, gpt-oss (la familia open que OpenAI relanzó en 2025) o GLM (Zhipu). No es exactamente "open source" en el sentido clásico —los datos de entrenamiento siguen siendo opacos en casi todos— pero sí lo bastante abierto como para descargar los pesos, instalarlos en tu propia infraestructura y, en muchos casos, hacer fine-tuning para tu caso.

La brecha existe, pero es manejable

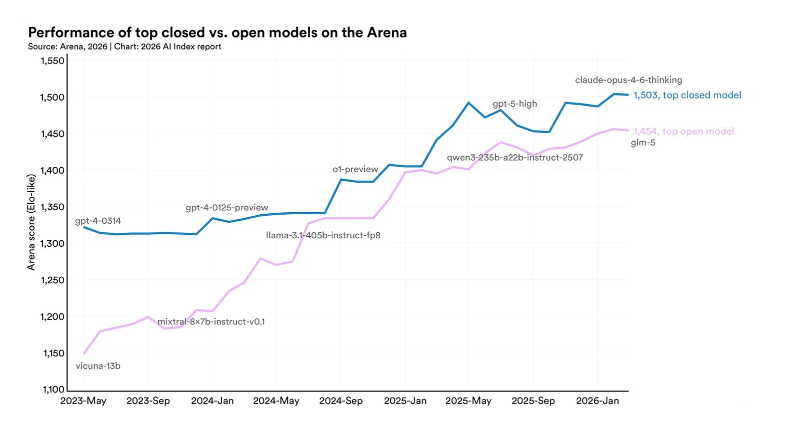

La gráfica de abajo es el resumen visual de los últimos tres años en el Chatbot Arena. La conclusión, en una frase: los modelos abiertos siempre van por detrás, pero la distancia se mantiene en un rango razonable. Traducido a tiempo: hoy puedes desplegar en tu casa modelos abiertos comparables a los mejores cerrados de hace 6–12 meses.

Para algunos usos, esa brecha de seis meses todavía es decisiva: razonamiento de varios pasos, agentes que orquestan herramientas, coding avanzado o cualquier cosa donde la diferencia entre "casi resuelve" y "resuelve" cambie el ROI del proyecto. Ahí los modelos de frontera siguen ganando por goleada.

Pero hay un universo entero de tareas donde no hace falta lo último de lo último: clasificar tickets de soporte, generar resúmenes de reuniones, etiquetar documentos contables, redactar borradores que un humano va a revisar igualmente, búsqueda semántica sobre documentación interna, extracción de campos de facturas. Para todo eso, un modelo abierto bien afinado rinde de sobra.

Por qué los abiertos están ganando terreno

Si el rendimiento basta, lo demás juega a favor:

- Coste marginal cercano a cero. No pagas por token, pagas electricidad y amortización del hardware. En cargas de volumen alto, la diferencia es de un orden de magnitud.

- Autonomía total. El proveedor no te puede deprecar el modelo de un día para otro, ni cambiar términos de uso, ni cortarte por exceder cuota.

- Control real sobre los datos. Lo que entra al modelo no sale del perímetro. Es la única arquitectura que te permite procesar información sensible (nóminas, contratos, datos clínicos) sin un acuerdo de tratamiento de datos eterno con un proveedor extranjero.

- GDPR y AI Act. Especialmente relevante en Europa: alojar el modelo en tu infraestructura te quita por encima un montón de complejidad regulatoria.

Y por qué no son la solución universal

El otro lado de la balanza pesa. Auto-alojar significa montar equipo: alguien que sepa de inferencia eficiente, GPUs, monitorización, seguridad de modelo, evals, despliegue. Y aun montándolo, no tendrás lo último —siempre vas detrás de la frontera.

El punto donde dejar la API y empezar a auto-alojar se vuelve económicamente rentable está más arriba de lo que la gente cree: hablamos de cientos de millones de tokens al mes sostenidos, normalmente. Por debajo de eso, la API gana por economía pura. No hay almuerzos gratis.

La arquitectura híbrida es la nueva normalidad

Las empresas que llevan dos años en esto ya no se preguntan "qué modelo elijo" sino "qué cartera de modelos compongo". El patrón que se está estandarizando es razonablemente simple:

- Tareas masivas, sensibles o repetitivas → modelo abierto auto-alojado.

- Tareas puntuales que requieren la última capacidad de razonamiento → API de frontera (Claude, GPT, Gemini).

- Capa de orquestación encima que enruta a uno u otro según coste, latencia y nivel de criticidad.

Es más complejo que casarte con un único proveedor, sí. Pero también es más maduro: dejas de tratar la IA como un commodity ("uso ChatGPT") y empiezas a tratarla como lo que es, una capa de cómputo con perfiles muy distintos según la tarea.

Una señal que vale la pena seguir

Cuando OpenAI lanzó gpt-oss —su primera familia de modelos con pesos abiertos en años— mucha gente lo interpretó como un gesto simbólico. Yo lo leo distinto. Cuando el líder histórico del mercado cerrado decide abrir, normalmente es porque mantener todo bajo llave ha empezado a salir más caro que dejarlo competir en abierto. Es exactamente lo que pasó con Linux frente a los Unix propietarios hace 25 años. Y el desenlace de aquella historia ya lo conocemos.

La pregunta interesante para 2026 no es ya "API o on-premise". Es: ¿qué porcentaje de tu cómputo de IA debería estar bajo tu control, y qué porcentaje puedes seguir alquilando? Cada empresa va a contestarla diferente, pero el que no se la haga en absoluto se va a despertar tarde.

Tags